大数据技术之Hadoop(HDFS)

文章目录

1)HDFS 产生背景

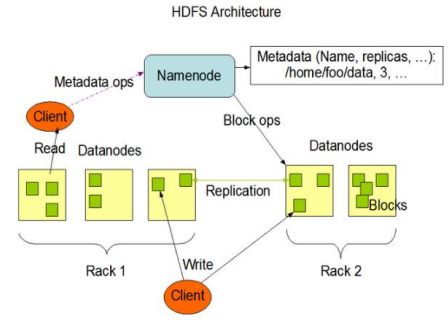

随着数据量越来越大,在一个操作系统存不下所有的数据,那么就分配到更多的操作系统管理的磁盘中,但是不方便管理和维护,迫切需要一种系统来管理多台机器上的文件,这就是分布式文件管理系统。HDFS 只是分布式文件管理系统中的一种 。

2)HDFS 定义

HDFS(Hadoop Distributed File System),它是一个文件系统,用于存储文件,通过目录树来定位文件; 其次,它是分布式的,由很多服务器联合起来实现其功能,集群中的服务器有各自的角色。HDFS 的使用场景:适合一次写入,多次读出的场景。一个文件经过创建、写入和关闭之后就不需要改变。

HDFS 的使用场景:适合一次写入,多次读出的场景。一个文件经过创建、写入和关闭之后就不需要改变 。

HDFS优点

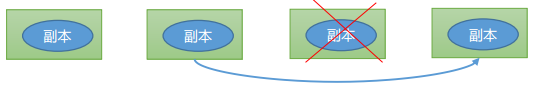

1)高容错性

数据自动保存多个副本。它通过增加副本的形式,提高容错性。

某一个副本丢失以后,它可以自动恢复。

2)适合处理大数据

数据规模:能够处理数据规模达到GB、TB、甚至PB级别的数据;

文件规模:能够处理百万规模以上的文件数量 ,数量相当之大。

3)可构建在廉价机器上,通过多副本机制,提高可靠性。

HDFS缺点

1)不适合低延时数据访问,比如毫秒级的存储数据,是做不到的。

2)无法高效的对大量小文件进行存储。

存储大量小文件的话,它会占用NameNode大量的内存来存储文件目录和块信息。这样是不可取的,因为NameNode的内存总是有限的;

小文件存储的寻址时间会超过读取时间,它违反了HDFS的设计目标。

HDFS的block大小可以设置,默认为128M,一个文件块目录都是占用150字节,128M能存储9亿个小文件目录信息

3)不支持并发写入、文件随机修改。

一个文件只能有一个写,不允许多个线程同时写

仅支持数据append(追加),不支持文件的随机修改。

1)NameNode(nn):就是Master,它是一个主管、管理者。

2)DataNode:就是Slave。NameNode下达命令,DataNode执行实际的操作。

3)Client:就是客户端。

4)SecondaryNameNode:并非NameNode的热备。当NameNode挂掉的时候,它并不能马上替换NameNode并提供服务。

(1)辅助NameNode,分担其工作量,比如定期合并Fsimage和Edits,并推送给NameNode ;

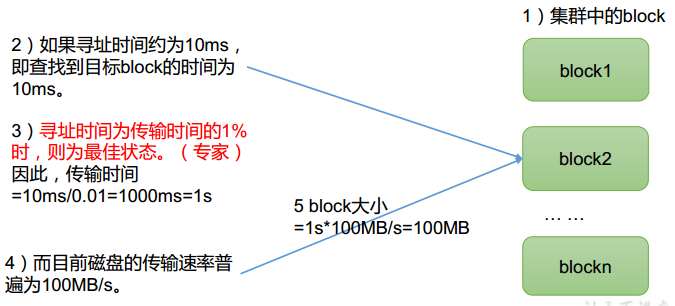

HDFS 中的文件在物理上是分块存储 (Block ) , 块的大小可以通过配置参数( dfs.blocksize)来规定,默认大小在Hadoop2.x/3.x版本中是128M,1.x版本中是64M。

思考 :为什么块的大小不能设置太小,也不能设置太大?

(1)HDFS的块设置太小,会增加寻址时间,程序一直在找块的开始位置;

(2)如果块设置的太大,从磁盘传输数据的时间会明显大于定位这个块开始位置所需的时间。导致程序在处理这块数据时,会非常慢。

总结:HDFS块的大小设置主要取决于磁盘传输速率。对于一般硬盘来说,传输速率为100M/s,一般设置块的大小128M,因为128是2的7次方,最接近于100M。固态硬盘一般传输速率为200M/s~300M/s,可以设置块大小为256M。在企业,128M和256M是常用的块大小。

或者

两个是完全相同的。

1 2 3 4 5 6 7 8 9 10 11 12 13 14 15 16 17 18 19 20 21 22 23 24 25 26 27 28 29 30 31 32 33 34 35 36 37 38 39 40 41 42 43 44 45 46 47 48 49 50 51 52 53 54 55 56 57 58 59 [wxler@wxler1 ~]$ cd /opt/module/hadoop-3.1.3/ [wxler@wxler1 hadoop-3.1.3]$ bin/hadoop fs Usage: hadoop fs [generic options] [-appendToFile <localsrc> ... <dst>] [-cat [-ignoreCrc] <src> ...] [-checksum <src> ...] [-chgrp [-R] GROUP PATH...] [-chmod [-R] <MODE[,MODE]... | OCTALMODE> PATH...] [-chown [-R] [OWNER][:[GROUP]] PATH...] [-copyFromLocal [-f] [-p] [-l] [-d] [-t <thread count>] <localsrc> ... <dst>] [-copyToLocal [-f] [-p] [-ignoreCrc] [-crc] <src> ... <localdst>] [-count [-q] [-h] [-v] [-t [<storage type >]] [-u] [-x] [-e] <path> ...] [-cp [-f] [-p | -p[topax]] [-d] <src> ... <dst>] [-createSnapshot <snapshotDir> [<snapshotName>]] [-deleteSnapshot <snapshotDir> <snapshotName>] [-df [-h] [<path> ...]] [-du [-s] [-h] [-v] [-x] <path> ...] [-expunge] [-find <path> ... <expression> ...] [-get [-f] [-p] [-ignoreCrc] [-crc] <src> ... <localdst>] [-getfacl [-R] <path>] [-getfattr [-R] {-n name | -d} [-e en] <path>] [-getmerge [-nl] [-skip-empty-file] <src> <localdst>] [-head <file>] [-help [cmd ...]] [-ls [-C] [-d] [-h] [-q] [-R] [-t] [-S] [-r] [-u] [-e] [<path> ...]] [-mkdir [-p] <path> ...] [-moveFromLocal <localsrc> ... <dst>] [-moveToLocal <src> <localdst>] [-mv <src> ... <dst>] [-put [-f] [-p] [-l] [-d] <localsrc> ... <dst>] [-renameSnapshot <snapshotDir> <oldName> <newName>] [-rm [-f] [-r|-R] [-skipTrash] [-safely] <src> ...] [-rmdir [--ignore-fail-on-non-empty] <dir> ...] [-setfacl [-R] [{-b|-k} {-m|-x <acl_spec>} <path>]|[--set <acl_spec> <path>]] [-setfattr {-n name [-v value] | -x name} <path>] [-setrep [-R] [-w] <rep> <path> ...] [-stat [format] <path> ...] [-tail [-f] [-s <sleep interval>] <file>] [-test -[defsz] <path>] [-text [-ignoreCrc] <src> ...] [-touch [-a] [-m] [-t TIMESTAMP ] [-c] <path> ...] [-touchz <path> ...] [-truncate [-w] <length> <path> ...] [-usage [cmd ...]] Generic options supported are: -conf <configuration file> specify an application configuration file -D <property=value> define a value for a given property -fs <file:///|hdfs://namenode:port> specify default filesystem URL to use, overrides 'fs.defaultFS' property from configurations. -jt <local |resourcemanager:port> specify a ResourceManager -files <file1,...> specify a comma-separated list of files to be copied to the map reduce cluster -libjars <jar1,...> specify a comma-separated list of jar files to be included in the classpath -archives <archive1,...> specify a comma-separated list of archives to be unarchived on the compute machines The general command line syntax is: command [genericOptions] [commandOptions][wxler@wxler1 hadoop-3.1.3]$

1)启动 Hadoop 集群(方便后续的测试)

1 2 [wxler@wxler1 hadoop-3.1.3]$ sbin/start-dfs.sh [wxler@wxler2 hadoop-3.1.3]$ sbin/start-yarn.sh

或者

2)-help:输出这个命令参数

1 2 3 4 5 6 7 8 9 10 11 12 13 14 [wxler@wxler1 hadoop-3.1.3]$ hadoop fs -help rm -rm [-f] [-r|-R] [-skipTrash] [-safely] <src> ... : Delete all files that match the specified file pattern. Equivalent to the Unix command "rm <src>" -f If the file does not exist, do not display a diagnostic message or modify the exit status to reflect an error. -[rR] Recursively deletes directories. -skipTrash option bypasses trash, if enabled, and immediately deletes <src>. -safely option requires safety confirmation, if enabled, requires confirmation before deleting large directory with more than <hadoop.shell.delete.limit.num.files> files. Delay is expected when walking over large directory recursively to count the number of files to be deleted before the confirmation.

3)创建/sanguo 文件夹

1 2 [wxler@wxler1 hadoop-3.1.3]$ hadoop fs -mkdir /sanguo [wxler@wxler1 hadoop-3.1.3]$ hadoop fs -mkdir /jinguo

1)-moveFromLocal:从本地移动 粘贴到 HDFS

1 2 3 4 [wxler@wxler1 hadoop-3.1.3]$ vim shuguo.txt 输入: shuguo [wxler@wxler1 hadoop-3.1.3]$ hadoop fs -moveFromLocal ./shuguo.txt /sanguo

如果移动到的/sanguo目录存在,则移动到该目录下,否则,将/sanguo作为移动后的文件,以下所有命令均如此。

2)-copyFromLocal:从本地文件系统中拷贝文件到 HDFS 路径去

1 2 3 4 [wxler@wxler1 hadoop-3.1.3]$ vim weiguo.txt 输入: weiguo [wxler@wxler1 hadoop-3.1.3]$ hadoop fs -copyFromLocal weiguo.txt /sanguo

3)-put:等同于 copyFromLocal,生产环境更习惯用 put

1 2 3 4 [wxler@wxler1 hadoop-3.1.3]$ vim weiguo.txt 输入: weiguo [wxler@wxler1 hadoop-3.1.3]$ hadoop fs -put weiguo.txt /sanguo

4)-appendToFile:将一个文件中的内容追加到已经存在的文件末尾

1 2 3 4 [wxler@wxler1 hadoop-3.1.3]$ vim liubei.txt 输入: liubei [atguigu@hadoop102 hadoop-3.1.3]$ hadoop fs -appendToFile liubei.txt /sanguo/shuguo.txt

1)-copyToLocal:从 HDFS 拷贝到本地

1 hadoop fs -copyToLocal /sanguo/shuguo.txt ./

2)-get:等同于 copyToLocal,生产环境更习惯用 get

1 hadoop fs -get /sanguo/shuguo.txt ./

1)-ls: 显示目录信息

2)-cat:显示文件内容

1 hadoop fs -cat /sanguo/shuguo.txt

3)-chgrp、-chmod、-chown:Linux 文件系统中的用法一样,修改文件所属权限

1 2 hadoop fs -chmod 666 /sanguo/shuguo.txt hadoop fs -chown wxler:wxler /sanguo/shuguo.txt

4)-mkdir:创建路径

1 hadoop fs -mkdir /jinguo

5)-cp:从 HDFS 的一个路径拷贝到 HDFS 的另一个路径

1 hadoop fs -cp /sanguo/shuguo.txt /jinguo

6)-mv:在 HDFS 目录中移动文件

1 2 hadoop fs -mv /sanguo/wuguo.txt /jinguo hadoop fs -mv /sanguo/weiguo.txt /jinguo

7)-tail:显示一个文件的末尾 1kb 的数据

1 hadoop fs -tail /sanguo/shuguo.txt

8)-rm:删除文件或文件夹

1 hadoop fs -rm /sanguo/shuguo.txt

9)-rm -r:递归删除目录及目录里面内容

1 hadoop fs -rm -r /sanguo

10)-du 统计文件夹的大小信息

1 2 3 4 5 6 [wxler@wxler1 hadoop-3.1.3]$ hadoop fs -du -s -h /jinguo 13 39 /jinguo [wxler@wxler1 hadoop-3.1.3]$ hadoop fs -du -h /jinguo 7 21 /jinguo/shuguo.txt 6 18 /jinguo/wuguo.txt

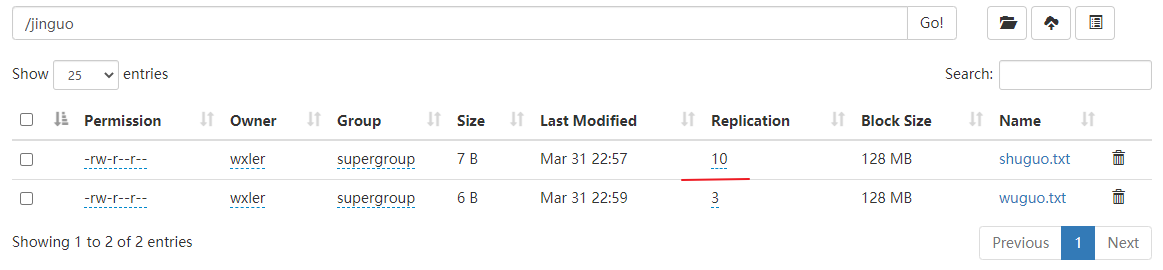

11)-setrep:设置 HDFS 中文件的副本数量

1 2 [wxler@wxler1 hadoop-3.1.3]$ hadoop fs -setrep 10 /jinguo/shuguo.txt Replication 10 set : /jinguo/shuguo.txt

这里设置的副本数只是记录在 NameNode 的元数据中,是否真的会有这么多副本,还得看DataNode 的数量 。因为目前只有 3 台设备,最多也就 3 个副本,只有节点数的增加到 10台时,副本数才能达到 10。

1) 找到资料包路径下的 Windows 依赖文件夹, 拷贝 hadoop-3.1.0 到非中文路径 (比如 d:\) 。

4)在 IDEA 中创建一个 Maven 工程 HdfsClientDemo,并导入相应的依赖坐标+日志添加

1 2 3 4 5 6 7 8 9 10 11 12 13 14 15 16 17 <dependencies > <dependency > <groupId > org.apache.hadoop</groupId > <artifactId > hadoop-client</artifactId > <version > 3.1.3</version > </dependency > <dependency > <groupId > junit</groupId > <artifactId > junit</artifactId > <version > 4.12</version > </dependency > <dependency > <groupId > org.slf4j</groupId > <artifactId > slf4j-log4j12</artifactId > <version > 1.7.30</version > </dependency > </dependencies >

在项目的 src/main/resources 目录下,新建一个文件,命名为“log4j.properties”,在文件中填入

1 2 3 4 5 6 7 8 log4j.rootLogger =INFO, stdout log4j.appender.stdout =org.apache.log4j.ConsoleAppender log4j.appender.stdout.layout =org.apache.log4j.PatternLayout log4j.appender.stdout.layout.ConversionPattern =%d %p [%c] - %m%n log4j.appender.logfile =org.apache.log4j.FileAppender log4j.appender.logfile.File =target/spring.log log4j.appender.logfile.layout =org.apache.log4j.PatternLayout log4j.appender.logfile.layout.ConversionPattern =%d %p [%c] - %m%n

5)创建包名:com.layne.hdfs

6)创建 HdfsClient 类

1 2 3 4 5 6 7 8 9 10 11 12 13 14 15 16 17 18 19 20 21 22 23 24 25 26 27 28 private FileSystem fs;@Before public void init () throws URISyntaxException, IOException, InterruptedException URI uri = new URI("hdfs://wxler1:8020" ); Configuration configuration = new Configuration(); String user = "wxler" ; fs = FileSystem.get(uri, configuration, user); } @After public void close () throws IOException fs.close(); } @Test public void testmkdir () throws URISyntaxException, IOException, InterruptedException fs.mkdirs(new Path("/xiyou/huaguoshan1" )); }

7)执行程序

客户端去操作 HDFS 时,是有一个用户身份的。默认情况下, HDFS 客户端 API 会从采用 Windows 默认用户访问 HDFS,会报权限异常错误。所以在访问 HDFS 时,一定要配置用户。

1 org.apache.hadoop.security.AccessControlException: Permission denied: user=56576, access=WRITE, inode="/xiyou/huaguoshan" :atguigu:supergroup:drwxr-xr-x

1)编写源代码

1 2 3 4 5 6 7 8 9 10 11 12 13 14 15 16 17 18 19 @Test public void testPut () throws IOException fs.copyFromLocalFile(false , true , new Path("D:\\test\\sunwukong.txt" ), new Path("hdfs://wxler1/xiyou/huaguoshan" )); } @Test public void testPut2 () throws IOException FSDataOutputStream fos = fs.create(new Path("/test/testHello" )); fos.write("hello world" .getBytes()); }

2)resources 资源目录下新建hdfs-site.xml设置如下内容

1 2 3 4 5 6 7 8 <?xml version="1.0" encoding="UTF-8"?> <?xml-stylesheet type="text/xsl" href="configuration.xsl"?> <configuration > <property > <name > dfs.replication</name > <value > 1</value > </property > </configuration >

3)参数优先级

1 2 3 4 5 6 7 8 @Test public void testGet () throws IOException fs.copyToLocalFile(false , new Path("/input/word.txt" ), new Path("D:\\test\\" ), false ); }

注意:如果执行上面代码,下载不了文件,有可能是你电脑的微软支持的运行库少,需要安装一下微软运行库。

1 2 3 4 5 6 7 8 9 10 11 12 13 14 @Test public void testmv () throws IOException fs.rename(new Path("/input" ), new Path("/output" )); }

1 2 3 4 5 6 7 8 9 10 11 12 13 14 @Test public void testRm () throws IOException fs.delete(new Path("/jinguo" ), true ); }

查看文件名称、权限、长度、块信息

1 2 3 4 5 6 7 8 9 10 11 12 13 14 15 16 17 18 19 20 21 22 23 24 25 26 27 28 @Test public void fileDetail () throws IOException RemoteIterator<LocatedFileStatus> listFiles = fs.listFiles(new Path("/" ), true ); while (listFiles.hasNext()) { LocatedFileStatus fileStatus = listFiles.next(); System.out.println("==========" + fileStatus.getPath() + "=========" ); System.out.println(fileStatus.getPermission()); System.out.println(fileStatus.getOwner()); System.out.println(fileStatus.getGroup()); System.out.println(fileStatus.getLen()); System.out.println(fileStatus.getModificationTime()); System.out.println(fileStatus.getReplication()); System.out.println(fileStatus.getBlockSize()); System.out.println(fileStatus.getPath().getName()); BlockLocation[] blockLocations = fileStatus.getBlockLocations(); System.out.println(Arrays.toString(blockLocations)); } }

1 2 3 4 5 6 7 8 9 10 11 12 13 14 15 @Test public void testFile () throws IOException FileStatus[] listStatus = fs.listStatus(new Path("/" )); for (FileStatus status : listStatus) { if (status.isFile()) { System.out.println("文件:" + status.getPath().getName()); } else { System.out.println("目录:" + status.getPath().getName()); } } }

请求 dn1(即DataNode1) 上传数据, dn1 收到请求会继续调用dn2,然后 dn2 调用 dn3,将这个通信管道建立完成 。

在 HDFS 写数据的过程中,NameNode 会选择距离待上传数据最近距离的 DataNode 接收数据。那么这个最近距离怎么计算呢?

节点距离:两个节点到达最近的共同祖先的距离总和 (其实就是数路径个数)。

大家算一算每两个节点之间的距离。

9和3的距离是3

10和4的距离是3

9和6的距离是2

1)机架感知说明 http://hadoop.apache.org/docs/r3.1.3/hadoop-project-dist/hadoop-hdfs/HdfsDesign.html#Data_Replication

For the common case, when the replication factor is three, HDFS’s placement policy is to put one replica on the local machine if the writer is on a datanode , otherwise on a random datanode, another replica on a node in a different (remote) rack , and the last on a different node in the same remote rack . This policy cuts the inter-rack write traffic which generally improves write performance. The chance of rack failure is far less than that of node failure; this policy does not impact data reliability and availability guarantees. However, it does reduce the aggregate network bandwidth used when reading data since a block is placed in only two unique racks rather than three. With this policy, the replicas of a file do not evenly distribute across the racks. One third of replicas are on one node, two thirds of replicas are on one rack, and the other third are evenly distributed across the remaining racks. This policy improves write performance without compromising data reliability or read performance.

(2)源码说明

2)Hadoop3.1.3 副本节点选择

第一个副本在Client所处的节点上。如果客户端在集群外,随机选一个。

第二个副本在另一个机架的随机一个节点

第三个副本在第二个副本所在机架的随机节点

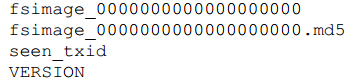

思考:NameNode 中的元数据是存储在哪里的?因此产生在磁盘中备份元数据的FsImage 。

这样又会带来新的问题,当在内存中的元数据更新时,如果同时更新 FsImage,就会导致效率过低,但如果不更新,就会发生一致性问题,一旦 NameNode 节点断电,就会产生数据丢失。因此,引入Edits 文件(只进行追加操作,效率很高)。每当元数据有更新或者添加元数据时,修改内存中的元数据并追加到 Edits中 。这样,一旦 NameNode 节点断电,可以通过 FsImage 和 Edits 的合并,合成元数据。

但是,如果长时间添加数据到 Edits 中,会导致该文件数据过大,效率降低,而且一旦断电,恢复元数据需要的时间过长。因此,需要定期进行 FsImage 和 Edits 的合并,如果这个操作由 NameNode 节点完成,又会效率过低。 因此,引入一个新的节点 SecondaryNamenode,专门用于 FsImage 和 Edits 的合并。

NameNode工作机制

2)第二阶段:Secondary NameNode 工作

NameNode被格式化之后,将在/opt/module/hadoop-3.1.3/data/dfs/name/current目录中产生如下文件

(1)Fsimage文件:HDFS文件系统元数据的一个永久性的检查点,其中包含HDFS文件系统的所有目录和文件inode的序列化信息(保存的是文件目录信息、文件目录和文件的关系,文件和目录的拥有者和权限等信息,并不存储每个文件的block在哪个节点的哪个位置)。edits_的数字

1)oiv 查看 Fsimage 文件

1 2 3 4 5 6 7 8 9 10 11 [wxler@wxler1 current]$ hdfs oiv Usage: bin/hdfs oiv [OPTIONS] -i INPUTFILE -o OUTPUTFILE Offline Image Viewer View a Hadoop fsimage INPUTFILE using the specified PROCESSOR, saving the results in OUTPUTFILE. [wxler@wxler1 current]$ hdfs oev Usage: bin/hdfs oev [OPTIONS] -i INPUT_FILE -o OUTPUT_FILE Offline edits viewer Parse a Hadoop edits log file INPUT_FILE and save results in OUTPUT_FILE.

(2)基本语法

1 hdfs oiv -p 输出后的件类型 -i 镜像文件 -o 转换后文件输出路径

(3)案例实操

1 2 3 4 [wxler@wxler1 current]$ pwd /opt/module/hadoop-3.1.3/data/dfs/name/current [wxler@wxler1 current]$ hdfs oiv -p XML -i fsimage_0000000000000000785 -o /opt/software/fsimage.xml 2021-04-01 15:27:49,788 INFO offlineImageViewer.FSImageHandler: Loading 3 strings

将显示的 xml 文件内容拷贝到 Idea 中创建的 xml 文件中,并格式化。显示结果如下。

1 2 3 4 5 6 7 8 9 10 11 12 13 14 15 16 17 18 19 20 21 22 23 24 25 26 27 28 29 30 31 32 33 34 35 36 37 38 39 40 41 42 43 44 45 46 47 48 49 50 51 52 53 54 55 56 57 58 59 60 61 62 63 64 65 66 67 68 69 70 71 72 73 74 75 76 77 78 79 80 81 82 83 84 85 86 87 88 89 90 91 92 93 94 95 96 97 98 99 100 101 102 103 104 105 106 107 108 109 110 111 112 113 114 115 116 117 118 119 120 121 122 123 124 125 126 127 128 129 130 131 132 133 134 135 <?xml version="1.0"?> <fsimage > <version > <layoutVersion > -64</layoutVersion > <onDiskVersion > 1</onDiskVersion > <oivRevision > ba631c436b806728f8ec2f54ab1e289526c90579</oivRevision > </version > <NameSection > <namespaceId > 1997025465</namespaceId > <genstampV1 > 1000</genstampV1 > <genstampV2 > 1088</genstampV2 > <genstampV1Limit > 0</genstampV1Limit > <lastAllocatedBlockId > 1073741910</lastAllocatedBlockId > <txid > 785</txid > </NameSection > <ErasureCodingSection > <erasureCodingPolicy > <policyId > 1</policyId > <policyName > RS-6-3-1024k</policyName > <cellSize > 1048576</cellSize > <policyState > DISABLED</policyState > <ecSchema > <codecName > rs</codecName > <dataUnits > 6</dataUnits > <parityUnits > 3</parityUnits > </ecSchema > </erasureCodingPolicy > <erasureCodingPolicy > <policyId > 2</policyId > <policyName > RS-3-2-1024k</policyName > <cellSize > 1048576</cellSize > <policyState > DISABLED</policyState > <ecSchema > <codecName > rs</codecName > <dataUnits > 3</dataUnits > <parityUnits > 2</parityUnits > </ecSchema > </erasureCodingPolicy > <erasureCodingPolicy > <policyId > 3</policyId > <policyName > RS-LEGACY-6-3-1024k</policyName > <cellSize > 1048576</cellSize > <policyState > DISABLED</policyState > <ecSchema > <codecName > rs-legacy</codecName > <dataUnits > 6</dataUnits > <parityUnits > 3</parityUnits > </ecSchema > </erasureCodingPolicy > <erasureCodingPolicy > <policyId > 4</policyId > <policyName > XOR-2-1-1024k</policyName > <cellSize > 1048576</cellSize > <policyState > DISABLED</policyState > <ecSchema > <codecName > xor</codecName > <dataUnits > 2</dataUnits > <parityUnits > 1</parityUnits > </ecSchema > </erasureCodingPolicy > <erasureCodingPolicy > <policyId > 5</policyId > <policyName > RS-10-4-1024k</policyName > <cellSize > 1048576</cellSize > <policyState > DISABLED</policyState > <ecSchema > <codecName > rs</codecName > <dataUnits > 10</dataUnits > <parityUnits > 4</parityUnits > </ecSchema > </erasureCodingPolicy > </ErasureCodingSection > <INodeSection > <lastInodeId > 16577</lastInodeId > <numInodes > 42</numInodes > <inode > <id > 16385</id > <type > DIRECTORY</type > <name > </name > <mtime > 1617241935401</mtime > <permission > wxler:supergroup:0755</permission > <nsquota > 9223372036854775807</nsquota > <dsquota > -1</dsquota > </inode > <inode > <id > 16386</id > <type > DIRECTORY</type > <name > input</name > <mtime > 1617179030778</mtime > <permission > wxler:supergroup:0755</permission > <nsquota > -1</nsquota > <dsquota > -1</dsquota > </inode > <inode > <id > 16387</id > <type > FILE</type > <name > word.txt</name > <replication > 3</replication > <mtime > 1617179030747</mtime > <atime > 1617241762636</atime > <preferredBlockSize > 134217728</preferredBlockSize > <permission > wxler:supergroup:0644</permission > <blocks > <block > <id > 1073741825</id > <genstamp > 1001</genstamp > <numBytes > 41</numBytes > </block > </blocks > <storagePolicyId > 0</storagePolicyId > </inode > <inode > <id > 16388</id > <type > FILE</type > <name > jdk-8u212-linux-x64.tar.gz</name > <replication > 3</replication > <mtime > 1617179195102</mtime > <atime > 1617200154241</atime > <preferredBlockSize > 134217728</preferredBlockSize > <permission > wxler:supergroup:0644</permission > <blocks > <block > <id > 1073741826</id > <genstamp > 1002</genstamp > <numBytes > 134217728</numBytes > </block > <block > <id > 1073741827</id > <genstamp > 1003</genstamp > <numBytes > 60795424</numBytes > </block > </blocks > <storagePolicyId > 0</storagePolicyId > </inode > <inode > <id > 16481</id > <type > DIRECTORY</type > <name > tmp</name > <mtime > 1617193613381</mtime > <permission > wxler:supergroup:0700</permission > <nsquota > -1</nsquota > <dsquota > -1</dsquota > </inode > <inode > <id > 16482</id > <type > DIRECTORY</type > <name > hadoop-yarn</name > <mtime > 1617183460322</mtime > <permission > wxler:supergroup:0700</permission > <nsquota > -1</nsquota > <dsquota > -1</dsquota > </inode > <inode > <id > 16483</id > <type > DIRECTORY</type > <name > staging</name > <mtime > 1617183479242</mtime > <permission > wxler:supergroup:0700</permission > <nsquota > -1</nsquota > <dsquota > -1</dsquota > </inode > <inode > <id > 16484</id > <type > DIRECTORY</type > <name > wxler</name > <mtime > 1617183460322</mtime > <permission > wxler:supergroup:0700</permission > <nsquota > -1</nsquota > <dsquota > -1</dsquota > </inode > <inode > <id > 16485</id > <type > DIRECTORY</type > <name > .staging</name > <mtime > 1617193660199</mtime > <permission > wxler:supergroup:0700</permission > <nsquota > -1</nsquota > <dsquota > -1</dsquota > </inode > <inode > <id > 16491</id > <type > DIRECTORY</type > <name > history</name > <mtime > 1617192501743</mtime > <permission > wxler:supergroup:0755</permission > <nsquota > -1</nsquota > <dsquota > -1</dsquota > </inode > <inode > <id > 16492</id > <type > DIRECTORY</type > <name > done_intermediate</name > <mtime > 1617183479283</mtime > <permission > wxler:supergroup:1777</permission > <nsquota > -1</nsquota > <dsquota > -1</dsquota > </inode > <inode > <id > 16493</id > <type > DIRECTORY</type > <name > wxler</name > <mtime > 1617193668311</mtime > <permission > wxler:supergroup:0770</permission > <nsquota > -1</nsquota > <dsquota > -1</dsquota > </inode > <inode > <id > 16506</id > <type > FILE</type > <name > job_1617183364434_0001-1617183465062-wxler-word+count-1617183512363-1-1-SUCCEEDED-default-1617183485850.jhist</name > <replication > 3</replication > <mtime > 1617183512613</mtime > <atime > 1617192833535</atime > <preferredBlockSize > 134217728</preferredBlockSize > <permission > wxler:supergroup:0770</permission > <blocks > <block > <id > 1073741873</id > <genstamp > 1049</genstamp > <numBytes > 22313</numBytes > </block > </blocks > <storagePolicyId > 0</storagePolicyId > </inode > <inode > <id > 16507</id > <type > FILE</type > <name > job_1617183364434_0001_conf.xml</name > <replication > 3</replication > <mtime > 1617183512745</mtime > <atime > 1617183512638</atime > <preferredBlockSize > 134217728</preferredBlockSize > <permission > wxler:supergroup:0770</permission > <blocks > <block > <id > 1073741874</id > <genstamp > 1050</genstamp > <numBytes > 214438</numBytes > </block > </blocks > <storagePolicyId > 0</storagePolicyId > </inode > <inode > <id > 16508</id > <type > DIRECTORY</type > <name > done</name > <mtime > 1617192683004</mtime > <permission > wxler:supergroup:0770</permission > <nsquota > -1</nsquota > <dsquota > -1</dsquota > </inode > <inode > <id > 16509</id > <type > DIRECTORY</type > <name > 2021</name > <mtime > 1617192683004</mtime > <permission > wxler:supergroup:0770</permission > <nsquota > -1</nsquota > <dsquota > -1</dsquota > </inode > <inode > <id > 16510</id > <type > DIRECTORY</type > <name > 03</name > <mtime > 1617192683004</mtime > <permission > wxler:supergroup:0770</permission > <nsquota > -1</nsquota > <dsquota > -1</dsquota > </inode > <inode > <id > 16511</id > <type > DIRECTORY</type > <name > 31</name > <mtime > 1617192683004</mtime > <permission > wxler:supergroup:0770</permission > <nsquota > -1</nsquota > <dsquota > -1</dsquota > </inode > <inode > <id > 16512</id > <type > DIRECTORY</type > <name > 000000</name > <mtime > 1617193668311</mtime > <permission > wxler:supergroup:0770</permission > <nsquota > -1</nsquota > <dsquota > -1</dsquota > </inode > <inode > <id > 16530</id > <type > FILE</type > <name > job_1617183364434_0002-1617192796187-wxler-word+count-1617192836116-1-1-SUCCEEDED-default-1617192808343.jhist</name > <replication > 3</replication > <mtime > 1617192837231</mtime > <atime > 1617192837151</atime > <preferredBlockSize > 134217728</preferredBlockSize > <permission > wxler:supergroup:0770</permission > <blocks > <block > <id > 1073741883</id > <genstamp > 1059</genstamp > <numBytes > 22312</numBytes > </block > </blocks > <storagePolicyId > 0</storagePolicyId > </inode > <inode > <id > 16531</id > <type > FILE</type > <name > job_1617183364434_0002_conf.xml</name > <replication > 3</replication > <mtime > 1617192837335</mtime > <atime > 1617192837251</atime > <preferredBlockSize > 134217728</preferredBlockSize > <permission > wxler:supergroup:0770</permission > <blocks > <block > <id > 1073741884</id > <genstamp > 1060</genstamp > <numBytes > 214430</numBytes > </block > </blocks > <storagePolicyId > 0</storagePolicyId > </inode > <inode > <id > 16537</id > <type > DIRECTORY</type > <name > logs</name > <mtime > 1617193613519</mtime > <permission > wxler:wxler:1777</permission > <nsquota > -1</nsquota > <dsquota > -1</dsquota > </inode > <inode > <id > 16538</id > <type > DIRECTORY</type > <name > wxler</name > <mtime > 1617193613527</mtime > <permission > wxler:wxler:0770</permission > <nsquota > -1</nsquota > <dsquota > -1</dsquota > </inode > <inode > <id > 16539</id > <type > DIRECTORY</type > <name > logs-tfile</name > <mtime > 1617193613532</mtime > <permission > wxler:wxler:0770</permission > <nsquota > -1</nsquota > <dsquota > -1</dsquota > </inode > <inode > <id > 16540</id > <type > DIRECTORY</type > <name > application_1617193351532_0001</name > <mtime > 1617193667187</mtime > <permission > wxler:wxler:0770</permission > <nsquota > -1</nsquota > <dsquota > -1</dsquota > </inode > <inode > <id > 16542</id > <type > DIRECTORY</type > <name > output</name > <mtime > 1617193657742</mtime > <permission > wxler:supergroup:0755</permission > <nsquota > -1</nsquota > <dsquota > -1</dsquota > </inode > <inode > <id > 16548</id > <type > FILE</type > <name > part-r-00000</name > <replication > 3</replication > <mtime > 1617193657514</mtime > <atime > 1617193657020</atime > <preferredBlockSize > 134217728</preferredBlockSize > <permission > wxler:supergroup:0644</permission > <blocks > <block > <id > 1073741891</id > <genstamp > 1067</genstamp > <numBytes > 36</numBytes > </block > </blocks > <storagePolicyId > 0</storagePolicyId > </inode > <inode > <id > 16550</id > <type > FILE</type > <name > _SUCCESS</name > <replication > 3</replication > <mtime > 1617193657756</mtime > <atime > 1617193657742</atime > <preferredBlockSize > 134217728</preferredBlockSize > <permission > wxler:supergroup:0644</permission > <storagePolicyId > 0</storagePolicyId > </inode > <inode > <id > 16553</id > <type > FILE</type > <name > job_1617193351532_0001-1617193609664-wxler-word+count-1617193657905-1-1-SUCCEEDED-default-1617193629222.jhist</name > <replication > 3</replication > <mtime > 1617193658493</mtime > <atime > 1617193658335</atime > <preferredBlockSize > 134217728</preferredBlockSize > <permission > wxler:supergroup:0770</permission > <blocks > <block > <id > 1073741893</id > <genstamp > 1069</genstamp > <numBytes > 22312</numBytes > </block > </blocks > <storagePolicyId > 0</storagePolicyId > </inode > <inode > <id > 16554</id > <type > FILE</type > <name > job_1617193351532_0001_conf.xml</name > <replication > 3</replication > <mtime > 1617193658907</mtime > <atime > 1617193658550</atime > <preferredBlockSize > 134217728</preferredBlockSize > <permission > wxler:supergroup:0770</permission > <blocks > <block > <id > 1073741894</id > <genstamp > 1070</genstamp > <numBytes > 214605</numBytes > </block > </blocks > <storagePolicyId > 0</storagePolicyId > </inode > <inode > <id > 16555</id > <type > FILE</type > <name > wxler2_38923</name > <replication > 3</replication > <mtime > 1617193667153</mtime > <atime > 1617193666741</atime > <preferredBlockSize > 134217728</preferredBlockSize > <permission > wxler:wxler:0640</permission > <blocks > <block > <id > 1073741895</id > <genstamp > 1071</genstamp > <numBytes > 133415</numBytes > </block > </blocks > <storagePolicyId > 0</storagePolicyId > </inode > <inode > <id > 16562</id > <type > DIRECTORY</type > <name > sanguo</name > <mtime > 1617202922040</mtime > <permission > wxler:supergroup:0755</permission > <nsquota > -1</nsquota > <dsquota > -1</dsquota > </inode > <inode > <id > 16564</id > <type > DIRECTORY</type > <name > jinguo</name > <mtime > 1617202922040</mtime > <permission > wxler:supergroup:0755</permission > <nsquota > -1</nsquota > <dsquota > -1</dsquota > </inode > <inode > <id > 16565</id > <type > FILE</type > <name > shuguo.txt</name > <replication > 10</replication > <mtime > 1617202640991</mtime > <atime > 1617202640469</atime > <preferredBlockSize > 134217728</preferredBlockSize > <permission > wxler:supergroup:0644</permission > <blocks > <block > <id > 1073741902</id > <genstamp > 1080</genstamp > <numBytes > 7</numBytes > </block > </blocks > <storagePolicyId > 0</storagePolicyId > </inode > <inode > <id > 16566</id > <type > FILE</type > <name > wuguo.txt</name > <replication > 3</replication > <mtime > 1617202754263</mtime > <atime > 1617202753913</atime > <preferredBlockSize > 134217728</preferredBlockSize > <permission > wxler:supergroup:0644</permission > <blocks > <block > <id > 1073741903</id > <genstamp > 1081</genstamp > <numBytes > 6</numBytes > </block > </blocks > <storagePolicyId > 0</storagePolicyId > </inode > <inode > <id > 16567</id > <type > FILE</type > <name > weibo.txt</name > <replication > 3</replication > <mtime > 1617202773064</mtime > <atime > 1617202772773</atime > <preferredBlockSize > 134217728</preferredBlockSize > <permission > wxler:supergroup:0644</permission > <blocks > <block > <id > 1073741904</id > <genstamp > 1082</genstamp > <numBytes > 6</numBytes > </block > </blocks > <storagePolicyId > 0</storagePolicyId > </inode > <inode > <id > 16568</id > <type > DIRECTORY</type > <name > xiyou</name > <mtime > 1617241702332</mtime > <permission > wxler:supergroup:0755</permission > <nsquota > -1</nsquota > <dsquota > -1</dsquota > </inode > <inode > <id > 16571</id > <type > DIRECTORY</type > <name > huaguoshan</name > <mtime > 1617243483208</mtime > <permission > wxler:supergroup:0755</permission > <nsquota > -1</nsquota > <dsquota > -1</dsquota > </inode > <inode > <id > 16572</id > <type > FILE</type > <name > sanguo.txt</name > <replication > 3</replication > <mtime > 1617241739247</mtime > <atime > 1617246645971</atime > <preferredBlockSize > 134217728</preferredBlockSize > <permission > wxler:supergroup:0644</permission > <blocks > <block > <id > 1073741906</id > <genstamp > 1084</genstamp > <numBytes > 6</numBytes > </block > </blocks > <storagePolicyId > 0</storagePolicyId > </inode > <inode > <id > 16574</id > <type > DIRECTORY</type > <name > test</name > <mtime > 1617241935402</mtime > <permission > wxler:supergroup:0755</permission > <nsquota > -1</nsquota > <dsquota > -1</dsquota > </inode > <inode > <id > 16575</id > <type > FILE</type > <name > testHello</name > <replication > 3</replication > <mtime > 1617241935843</mtime > <atime > 1617241935402</atime > <preferredBlockSize > 134217728</preferredBlockSize > <permission > wxler:supergroup:0644</permission > <blocks > <block > <id > 1073741908</id > <genstamp > 1086</genstamp > <numBytes > 11</numBytes > </block > </blocks > <storagePolicyId > 0</storagePolicyId > </inode > <inode > <id > 16577</id > <type > FILE</type > <name > sunwukong.txt</name > <replication > 2</replication > <mtime > 1617243483601</mtime > <atime > 1617243483208</atime > <preferredBlockSize > 134217728</preferredBlockSize > <permission > wxler:supergroup:0644</permission > <blocks > <block > <id > 1073741910</id > <genstamp > 1088</genstamp > <numBytes > 9</numBytes > </block > </blocks > <storagePolicyId > 0</storagePolicyId > </inode > </INodeSection > <INodeReferenceSection > </INodeReferenceSection > <SnapshotSection > <snapshotCounter > 0</snapshotCounter > <numSnapshots > 0</numSnapshots > </SnapshotSection > <INodeDirectorySection > <directory > <parent > 16385</parent > <child > 16386</child > <child > 16388</child > <child > 16564</child > <child > 16542</child > <child > 16562</child > <child > 16574</child > <child > 16481</child > <child > 16568</child > </directory > <directory > <parent > 16386</parent > <child > 16387</child > </directory > <directory > <parent > 16481</parent > <child > 16482</child > <child > 16537</child > </directory > <directory > <parent > 16482</parent > <child > 16483</child > </directory > <directory > <parent > 16483</parent > <child > 16491</child > <child > 16484</child > </directory > <directory > <parent > 16484</parent > <child > 16485</child > </directory > <directory > <parent > 16491</parent > <child > 16508</child > <child > 16492</child > </directory > <directory > <parent > 16492</parent > <child > 16493</child > </directory > <directory > <parent > 16508</parent > <child > 16509</child > </directory > <directory > <parent > 16509</parent > <child > 16510</child > </directory > <directory > <parent > 16510</parent > <child > 16511</child > </directory > <directory > <parent > 16511</parent > <child > 16512</child > </directory > <directory > <parent > 16512</parent > <child > 16506</child > <child > 16507</child > <child > 16530</child > <child > 16531</child > <child > 16553</child > <child > 16554</child > </directory > <directory > <parent > 16537</parent > <child > 16538</child > </directory > <directory > <parent > 16538</parent > <child > 16539</child > </directory > <directory > <parent > 16539</parent > <child > 16540</child > </directory > <directory > <parent > 16540</parent > <child > 16555</child > </directory > <directory > <parent > 16542</parent > <child > 16550</child > <child > 16548</child > </directory > <directory > <parent > 16562</parent > <child > 16567</child > </directory > <directory > <parent > 16564</parent > <child > 16565</child > <child > 16566</child > </directory > <directory > <parent > 16568</parent > <child > 16571</child > </directory > <directory > <parent > 16571</parent > <child > 16572</child > <child > 16577</child > </directory > <directory > <parent > 16574</parent > <child > 16575</child > </directory > </INodeDirectorySection > <FileUnderConstructionSection > </FileUnderConstructionSection > <SecretManagerSection > <currentId > 0</currentId > <tokenSequenceNumber > 0</tokenSequenceNumber > <numDelegationKeys > 0</numDelegationKeys > <numTokens > 0</numTokens > </SecretManagerSection > <CacheManagerSection > <nextDirectiveId > 1</nextDirectiveId > <numDirectives > 0</numDirectives > <numPools > 0</numPools > </CacheManagerSection > </fsimage >

思考:可以看出,Fsimage 中没有记录块所对应 DataNode,为什么?

在集群启动后,要求 DataNode 上报数据块信息,并间隔一段时间后再次上报。

2)oev 查看 Edits 文件

1 hdfs oev -p 转换后的文件类型 -i 编辑日志 -o 转换后文件输出路径

(2)案例实操

1 2 3 [wxler@wxler1 current]$ hdfs oev -p XML -i edits_inprogress_0000000000000000786 -o /opt/software/edits.xml [wxler@wxler1 current]$ pwd /opt/module/hadoop-3.1.3/data/dfs/name/current

将显示的 xml 文件内容拷贝到 Idea 中创建的 xml 文件中,并格式化。显示结果如下。

1 2 3 4 5 6 7 8 9 10 <?xml version="1.0" encoding="UTF-8" standalone="yes"?> <EDITS > <EDITS_VERSION > -64</EDITS_VERSION > <RECORD > <OPCODE > OP_START_LOG_SEGMENT</OPCODE > <DATA > <TXID > 786</TXID > </DATA > </RECORD > </EDITS >

可以看到,edits记录了操作,只不过这段时间操作比较少。

思考:NameNode 如何确定下次开机启动的时候合并哪些 Edits?edits_的数字,是最新的edits。

1)通常情况下,SecondaryNameNode 每隔一小时执行一次,或每执行一百万次事务执行一次(每隔60s检查一次事务操作次数)。

1 2 3 4 5 6 7 8 9 10 11 12 13 14 15 16 17 18 19 20 21 22 23 24 25 26 27 28 <property> <name>dfs.namenode.checkpoint.period</name> <value>3600s</value> <description> The number of seconds between two periodic checkpoints. Support multiple time unit suffix(case insensitive), as described in dfs.heartbeat.interval. </description> </property> <property> <name>dfs.namenode.checkpoint.txns</name> <value>1000000</value> <description>The Secondary NameNode or CheckpointNode will create a checkpoint of the namespace every 'dfs.namenode.checkpoint.txns' transactions, regardless of whether 'dfs.namenode.checkpoint.period' has expired. </description> </property> <property> <name>dfs.namenode.checkpoint.check.period</name> <value>60s</value> <description>The SecondaryNameNode and CheckpointNode will poll the NameNode every 'dfs.namenode.checkpoint.check.period' seconds to query the number of uncheckpointed transactions. Support multiple time unit suffix(case insensitive), as described in dfs.heartbeat.interval. </description> </property>

可以在hdfs-site.xml里进行修改

(1)一个数据块在 DataNode 上以文件形式存储在磁盘上,包括两个文件,一个是数据本身,一个是元数据包括数据块的长度,块数据的校验和,以及时间戳。

DN 扫描自己节点块信息列表的时间,默认 6 小时,目的是查好DN中的块是否完好

1 2 3 4 5 6 7 8 9 <property > <name > dfs.datanode.directoryscan.interval</name > <value > 21600s</value > <description > Interval in seconds for Datanode to scan data directories and reconcile the difference between blocks in memory and on the disk. Support multiple time unit suffix(case insensitive), as described in dfs.heartbeat.interval. </description > </property >

DN 向 NN 汇报当前解读信息的时间间隔(将完好的块信息报告给NN),默认 6 小时;

1 2 3 4 5 <property> <name>dfs.blockreport.intervalMsec</name> <value>21600000</value> <description>Determines block reporting interval in milliseconds.</description> </property>

(3)心跳是每 3 秒一次,心跳返回结果带有 NameNode 给该 DataNode 的命令如复制块数据到另一台机器,或删除某个数据块。 如果超过 10 分钟 + 30s 没有收到某个 DataNode 的心跳,则认为该节点不可用。

(4)集群运行中可以安全加入和退出一些机器。

思考:如果电脑磁盘里面存储的数据是控制高铁信号灯的红灯信号 (1)和绿灯信号 (0) ,但是存储该数据的磁盘坏了,一直显示是绿灯,是否很危险?同理 DataNode 节点上的数据损坏了,却没有发现,是否也很危险,那么如何解决呢?

思考:如果电脑磁盘里面存储的数据是控制高铁信号灯的红灯信号 (1)和绿灯信号 (0) ,但是存储该数据的磁盘坏了,一直显示是绿灯,是否很危险?同理 DataNode 节点上的数据损坏了,却没有发现,是否也很危险,那么如何解决呢?

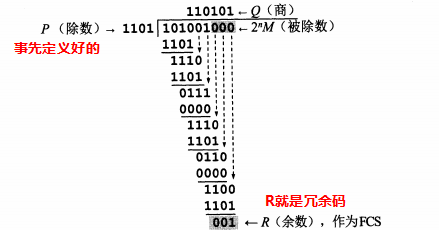

循环冗余校验补充

在发送端,先把数据划分为组,假定每组k个比特 。现假定待传送的数据M=101001(k=6). CRC运算就是在数据M的后面添加供差错检测用的n位冗余码,然后构成一个帧发送出去,一共发送(k+n)位。在所要发送的数据后面增加n位的冗余码,虽然增大了数据传输的开销,但却可以进行差错检测。 当传输可能出现差错时,付出这种代价往往是很值得的。

在接收端把接收到的数据以帧为单位进行 CRC 检验: 把收到的每一个帧都除以同样的除数P(模2运算),然后检查得到的余数R。如果在传输过程中无差错,那么经过CRC 检验后得出的余数R肯定是0(读者可以自己验算一下。被除数现在是101001001,而除数是P=1101,看余数R是否为0)。

需要注意的是 hdfs-site.xml 配置文件中的 heartbeat.recheck.interval 的单位为毫秒,dfs.heartbeat.interval 的单位为秒。

1 2 3 4 5 6 7 8 9 10 11 12 13 14 15 16 17 18 19 20 21 22 <property> <name>dfs.namenode.heartbeat.recheck-interval</name> <value>300000</value> <description> This time decides the interval to check for expired datanodes. With this value and dfs.heartbeat.interval, the interval of deciding the datanode is stale or not is also calculated. The unit of this configuration is millisecond. </description> </property> <property> <name>dfs.heartbeat.interval</name> <value>3s</value> <description> Determines datanode heartbeat interval in seconds. Can use the following suffix (case insensitive): ms(millis), s(sec), m(min), h(hour), d(day) to specify the time (such as 2s, 2m, 1h, etc.). Or provide complete number in seconds (such as 30 for 30 seconds). </description> </property>